Fausse ou réelle ? La détection d’images créées par IA d’un point de vue forensique

Ce contenu est également publié dans Forensic Magazine. Les résultats de recherche ont fait l’objet d’une consultation préalable lors de la conférence Techno Security & Digital Forensics en juin 2024.

Lorsque des deepfakes explicites de Taylor Swift ont inondé Internet, ce fut un moment stupéfiant et révélateur. Si la plus grande popstar du monde peut être victime « d’exploitation » sexuelle, alors n’importe lequel d’entre nous peut l’être également. Les ramifications sociales de l’IA générative utilisée pour des actes horribles sont déjà présentes – maintenant la société doit s’y attaquer et les législateurs doivent agir rapidement.

Il est encourageant que le ministère de la Justice américain ait récemment arrêté un ingénieur logiciel du Wisconsin accusé d’avoir créé du contenu d’abus sexuel d’enfants (CSAM) généré par l’IA, affirmant que puisque la technologie a appris à partir d’images réelles, il s’agit du même crime. Seulement une douzaine d’Etats disposent de lois en vigueur avec des pouvoirs de poursuite pour s’attaquer aux mauvais acteurs générant ce matériel nuisible et explicite. Nous continuons de baisser la tête quand nous entendons nos partenaires des forces de l’ordre signaler avoir porté une affaire devant le procureur qui leur a dit qu’il n’y avait aucun moyen de poursuivre.

Application génératrice d’images IA. Personne créant de l’art photo avec un logiciel d’intelligence artificielle intégré à un ordinateur portable.

Alors que les législateurs se réveillent et mettent rapidement en place des lois qui tiennent ces auteurs pour responsables de leurs actes, nous avons mené des recherches pour examiner à quoi ressemblent ces images d’un point de vue forensique. Ainsi, lorsque le moment viendra de monter un dossier, les forces de l’ordre disposeront de l’information dont elles ont besoin pour trouver les preuves nécessaires pour que les contrevenants aient à répondre de leurs actes.

Comment fonctionne l’IA générative

L’IA générative est exactement ce que son nom suggère : elle est conçue pour générer du contenu nouveau. Ce nouveau contenu est créé sur la base des modèles appris à partir des données saisies par l’utilisateur et il imite le style et la structure du contenu original.

Ces machines améliorent les performances avec le temps, on appelle cela l’apprentissage automatique, grâce à des données plus précises à partir desquelles elles apprennent. Et cela génère de nouvelles données basées sur les saisies, y compris du texte, des images, etc.. Il s’agit donc pour la machine d’apprendre, de faire des prédictions et de prendre des décisions pour vous.

À l’œil nu, il est difficile de discerner une fausse image d’une vraie. Et pourtant, en combinant les déclarations de la victime à l’appareil suspect en question, vous êtes sur la bonne voie pour comprendre celui qui l’a créée.

Concentrez-vous sur ce qui manque

Alerte spoiler – d’un point de vue forensique, il n’y a pas de drapeau rouge flagrant. Pourtant, il y a des éléments clés qui manquent dans une image créée par IA, ce qui vous donnera un excellent point de départ dans votre enquête.

Un fichier qui sera essentiel dans les enquêtes est le format JPEG Universal Metadata Box Format (JUMBF). Apprenez-le et comprenez-le. Il s’agit d’une norme pour l’intégration de métadonnées dans des fichiers JPEG, permettant de stocker différents types d’informations dans un seul fichier de manière structurée et standardisée. Vous aurez votre format de conteneur binaire, et vous voudrez rechercher le C2PA (Content Provenance and Authenticity), qui lie cryptographiquement les métadonnées avec des hash à un média particulier.

Nos conclusions

En général, la taille de fichier d’une image créée par IA est plus petite, mais vous ne pouvez pas simplement utiliser cela pour l’identifier. Pourtant, c’est un bon marqueur de départ.

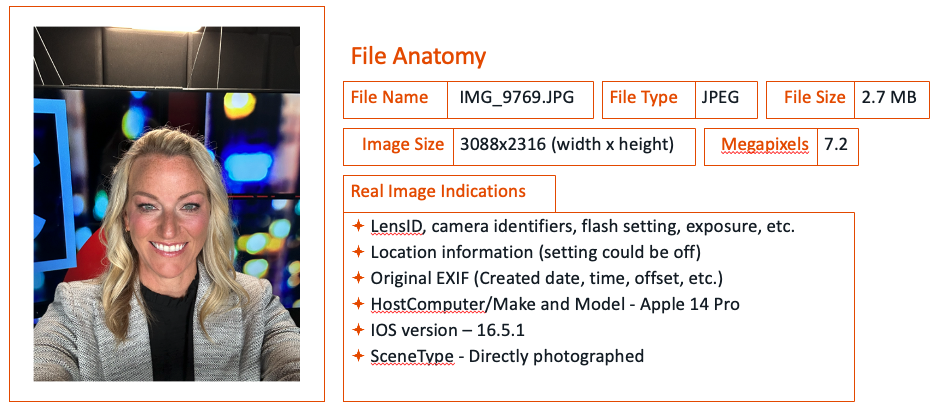

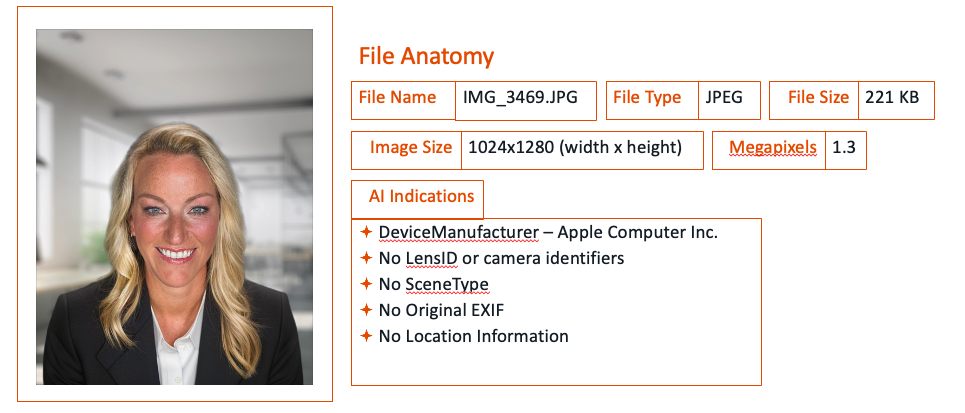

Si vous comparez une image créée par IA à une image réelle, vous constaterez que les images réelles « donnent » tout. Voici un exemple d’une image réelle de Heather à gauche et d’une image créée par IA à droite.

L’image réelle montre tout :

- LensID, ID appareil photo, réglage du flash, exposition, etc.

- Données de géolocalisation (notez que le réglage peut être désactivé)

- EXIF original (date de création, heure, décalage, etc.)

- HostComputer/Marque et modèle – Apple 14 Pro

- Version iOS – 16.5.1

- Type de scène – Directement photographié

Dans l’image créée par IA, il manque les données suivantes :

- DeviceManufacturer – Apple Computer Inc.

- Aucun LensID ou identifiant d’appareil photo

- Aucun type de scène

- Aucun EXIF original

- Aucune donnée de géolocalisation

Pour résumer : il manque le chemin du fichier, la taille du fichier et d’autres métadonnées typiques des images, des noms de fichiers, etc., dans les images créées par IA – comme si l’appareil n’avait aucune idée d’où il venait.

Toujours s’appuyer sur le travail d’enquête classique de l’investigation numérique

- Commencez par les bases: faites une analyse comparative de ce qui est normal pour l’appareil. Comment se comporte-t-il ? À quoi doivent ressembler les fichiers ?

- Utilisez la chronologie: comme vous le feriez dans n’importe quel cas, regardez de près ce qui se passait au moment de la création du fichier. Qu’est-ce qui a été utilisé ? Qu’est-ce qui manque ?

- Suivez l’argent: le bon travail d’enquêteur à l’ancienne intervient toujours dans les enquêtes numériques. Il existe des outils gratuits de génération d’IA, mais le dicton « en avoir pour son argent » s’applique bien ici. Pour ceux qui créent des images sophistiquées, il faut vraiment payer pour avoir accès à l’outil d’IA. Ce paiement est une excellente piste d’enquête à suivre.

Quand nous avons commencé cette recherche, nous étions très concentrés sur ce que nous allions trouver. En fin de compte, c’est ce qui manque qui est important.

Cela devrait vous donner une base solide sur laquelle bâtir votre enquête, en espérant que des lois existent pour vous permettre de monter un bon dossier afin de tenir le créateur d’image responsable.

À propos des auteurs

Heather Barnhart est directrice générale de l’engagement communautaire chez Cellebrite, leader mondial des solutions d’investigation numérique de premier ordre pour les secteurs public et privé. Elle éduque et conseille les professionnels de l’investigation numérique sur des cas dans le monde entier. Pendant plus de 20 ans, Heather a travaillé sur des affaires très médiatisées, enquêtant sur tout, de l’exploitation des enfants aux médias numériques d’Oussama Ben Laden.

Jared Barnhart est le chef d’équipe expérience client chez Cellebrite, leader mondial de solutions d’investigation numérique de premier ordre pour les secteurs public et privé. Ancien enquêteur et ingénieur en forensique mobile, Jared est hautement spécialisé dans le domaine de l’investigation numérique, formant régulièrement les forces de l’ordre et prêtant son expertise pour les aider à résoudre des affaires et accélérer la justice.