Fake oder echt? Erkennung von KI-Bildern mithilfe eines forensischen Objektivs

Dieser Inhalt wird auch im Forensic Magazine veröffentlicht. Die Forschungserkenntnisse wurden zunächst im Rahmen der Techno Security & Digital Forensics Conference im Juni 2024 besprochen.

Die massenhafte Verbreitung anstößiger Deepfakes von Taylor Swift im Internet war ein beeindruckendes, aber auch aufrüttelndes Schlüsselereignis. Denn wenn selbst einer der berühmtesten Popstars der Welt Opfer von sexueller Ausbeutung werden kann, dann kann dies wohl jedem von uns passieren. Schon jetzt sind wir mit den gesellschaftlichen Auswirkungen generativer KI konfrontiert, die für schreckliche Taten genutzt wird. Es liegt an uns als Gesellschaft, das Problem in den Griff zu bekommen, und es werden dringend entsprechende Gesetze benötigt.

Ermutigend ist, dass das Justizministerium vor Kurzem einen Softwareentwickler aus Wisconsin verhaftete, der im Verdacht steht, KI-generierte Kindesmissbrauchsmaterialien erstellt zu haben. Als Begründung wurde angegeben, dass es sich um dieselbe Straftat handelt, da die Technologie von den echten Bildern lernt. Nur ein Dutzend Staaten verfügt über Gesetze, die auch eine strafrechtliche Verfolgung der Ersteller dieser schädlichen, expliziten Materialien ermöglicht. Umso frustrierender, wenn wir von unseren Partnern in der Strafverfolgung erfahren, dass sie einen Fall vor den Bezirksstaatsanwalt gebracht haben – nur um zu erfahren, dass eine strafrechtliche Verfolgung nicht möglich ist.

KI-Bildgenerator-App. Person, die mithilfe von KI-Software auf einem Laptop Fotokunst erstellt.

Da sich die Gesetzgeber nun der Gefahr bewusst werden und schnell entsprechende Gesetze einführen, haben wir uns diese Bilder aus der forensischen Perspektive näher angesehen, damit die Strafverfolgungsbehörden zur Erstellung eines Falles über die nötigen Informationen verfügen, um die Straftäter vor Gericht zu bringen.

Wie funktioniert generative KI?

Generative KI ist genau das, wonach es sich anhört – sie ist darauf ausgelegt, neue Inhalte zu generieren. Die neuen Inhalte werden auf der Grundlage von Mustern erstellt, die aus den vom Benutzer eingegebenen Daten gelernt wurden, und ahmt den Stil und die Struktur des ursprünglichen Inhalts nach.

Die „Maschine“ verbessert im Laufe der Zeit ihre Leistung. Man bezeichnet das als maschinelles Lernen, und die Daten, aus denen sie lernt, werden immer genauer. In weiterer Folge werden ausgehend von den Eingaben, einschließlich Text, Bildern und noch weiteren Elementen, neue Daten erzeugt. Im Wesentlichen lernt die Maschine aus den Daten, um für Sie Prognosen anstellen und Entscheidungen treffen zu können.

Mit dem bloßen Auge ist heutzutage oft nur schwer erkennbar, ob ein Foto echt ist oder künstlich erstellt wurde. Allerdings bieten die Aussagen von Opfern in Kombination mit dem betreffenden Gerät eines Verdächtigen häufig die Möglichkeit, mehr über den Urheber zu erfahren.

Konzentrieren Sie sich auf das, was fehlt

Spoileralarm: Aus forensischer Sicht gibt es nicht das eine, überdeutliche Indiz für KI-generierte Inhalte. Tatsächlich sind es oft eher die Dinge, die KI-Bildern fehlen, die als Ausgangspunkt Ihrer Nachforschungen dienen können.

Eine Datei, die für Ermittlungen unverzichtbar ist, ist ein JPEG Universal Metadata Box Format (JUMBF). Machen Sie sich damit vertraut und verstehen Sie es. Es handelt sich um einen Standard zur Einbettung von Metadaten in JPEG-Dateien, der die strukturierte, standardisierte Speicherung verschiedener Arten von Informationen in einer einzigen Datei ermöglicht. Dabei steht ein binäres Container-Format zur Verfügung, und Sie haben die Möglichkeit, die C2PA (Content Provenance and Authenticity) zu überprüfen, die Metadaten kryptografisch mit Hashes mit einem bestimmten Medieninhalt verknüpft.

Unsere Erkenntnisse

Generell ist die Dateigröße eines KI-Bildes meist kleiner, allerdings reicht dieses Detail nicht aus, um ein solches sicher zu erkennen. Dennoch ist sie bereits ein guter Hinweis, um weiter nachzuforschen.

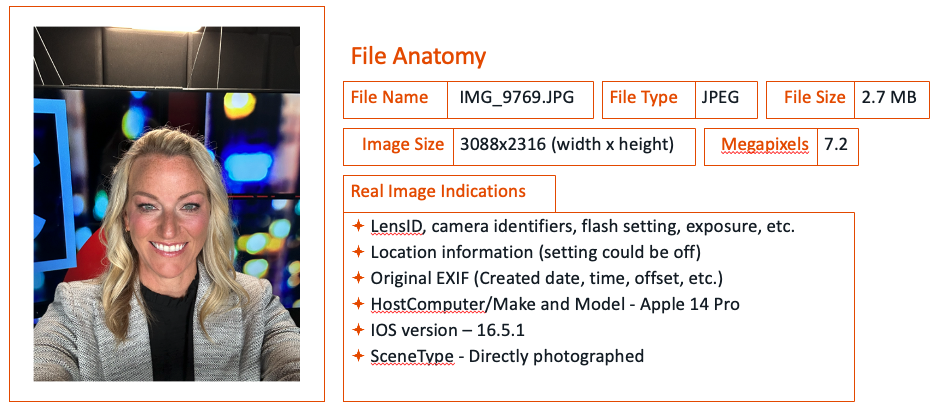

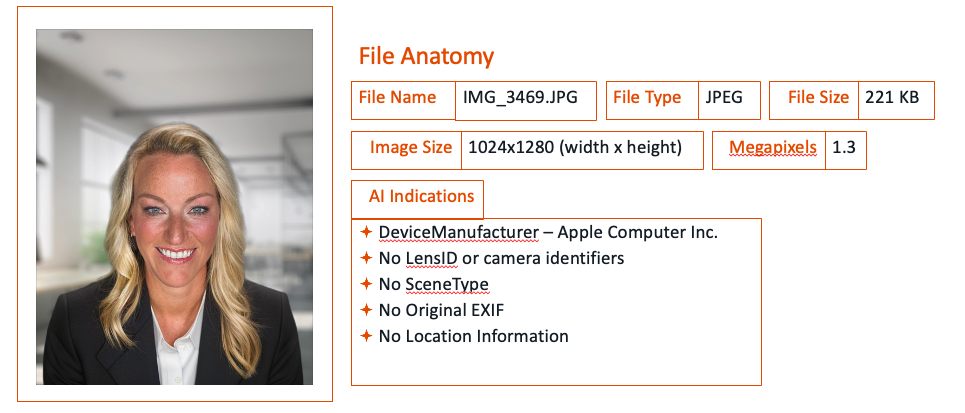

Vergleicht man ein KI-Bild mit einem echten Bild, wird erkennbar, dass beim echten Bild alles angegeben ist. Hier ein Beispiel: Das linke Bild ist ein echtes Bild von Heather, und das rechte Bild ist ein KI-Bild.

Das echte Bild enthält alle Informationen:

- ID des Objektivs, Kamera-ID, Blitzeinstellungen, Belichtung usw.

- Standortinformationen (diese Einstellung könnte deaktiviert sein)

- Original-EXIF (Erstelldatum, -uhrzeit, Offset usw.)

- HostComputer/Marke und Modell – Apple 14 Pro

- iOS-Version – 16.5.1

- Szenentyp – direkt fotografiert

Im KI-Bild fehlten die folgenden Daten:

- Gerätehersteller – Apple Computer Inc.

- Keine Objektiv-ID oder Kamera-Identifikatoren

- Kein Szenentyp

- Kein Original-EXIF

- Keine Standortinformationen

Zusammenfassend: Dateipfad, Dateigröße und weitere Metadaten, die für Bilder typisch sind, sowie der Dateiname usw. fehlen bei KI-Bildern – als hätte das Gerät keine Ahnung, woher die Bilder stammen.

Setzen Sie stets auf traditionelle digitale Forensik-Ermittlungen

- Beginnen Sie mit dem Grundlegenden: Legen Sie fest, was bei dem Gerät normal ist. Wie verhält es sich? Wie sollten die Dateien aussehen?

- Verwenden Sie zeitliche Anhaltspunkte: Sehen Sie sich, wie bei jedem Fall, genau die Geschehnisse zum Zeitpunkt der Dateierstellung an. Was wurde verwendet? Was fehlt?

- Verfolgen Sie Geldströme: Altbewährte Detektivarbeit spielt auch bei digitalen Ermittlungen eine Rolle. Es gibt kostenlose Tools für KI, aber die Redewendung „Qualität hat ihren Preis“ trifft hier richtig zu. Wenn Sie komplexe Bilder erstellen möchten, müssen Sie ein kostenpflichtiges KI-Tool verwenden. Somit bilden Zahlungen an KI-Dienstleister eine wichtige Spur.

Als wir mit dieser Forschung begannen, konzentrierten wir uns darauf, was wir finden würden. Und letztlich war genau das, was fehlte, relevant.

Dies kann als solide Basis für Ihre Ermittlungen dienen, und man kann nur hoffen, dass es dann auch Gesetze gibt, damit Sie einen soliden Fall erstellen und den Ersteller des Bildes zur Rechenschaft ziehen können.

Über die Autoren

Heather Barnhart ist Senior Director of Community Engagement bei Cellebrite, einem weltweiten Marktführer bei ausgereiften digitalen Ermittlungslösungen für den öffentlichen und privaten Sektor. Sie bildet Fachkräfte im Bereich der digitalen Forensik aus und berät diese weltweit in Fällen. Heather arbeitet bereits seit mehr als 20 Jahren an hochkarätigen Fällen, von Kindesmissbrauch bis hin zu den digitalen Medien von Osama Bin Laden.

Jared Barnhart ist Customer Experience Team Lead bei Cellebrite, einem weltweiten Marktführer bei ausgereiften digitalen Ermittlungslösungen für den öffentlichen und privaten Sektor. Als ehemaliger Kriminalbeamter und Technikexperte im Bereich der Mobilgeräte-Forensik ist Jared in der digitalen Forensik sehr erfahren und bildet regelmäßig Strafverfolgungsbeamte aus und berät sie in ihrer Fallaufklärungsarbeit.